Amazon Web Services и компания Cerebras Systems 13 марта 2026 года объявили о стратегическом партнёрстве, цель которого — сделать инференс больших языковых моделей в облаке максимально быстрым. Решение будет доступно через сервис Amazon Bedrock и объединит мощности чипов AWS Trainium и уникального процессора Cerebras WSE-3, размер которого в 56 раз превышает самый крупный GPU на рынке.

Ключевая инновация — так называемая дезагрегированная архитектура инференса. Чипы AWS Trainium берут на себя фазу предзаполнения (prefill), а процессор Cerebras WSE-3 оптимизирован для фазы декодирования (decode). Два разных вычислительных этапа обрабатываются специализированным оборудованием, что даёт пятикратный прирост пропускной способности токенов в том же аппаратном формате.

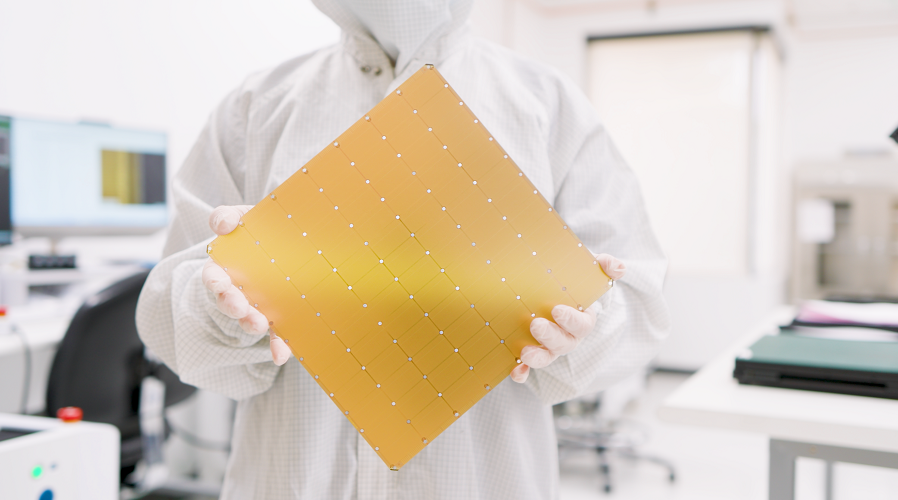

Характеристики WSE-3 впечатляют: 900 000 вычислительных ядер и 44 ГБ встроенной SRAM-памяти на одном кристалле. Внутренняя пропускная способность памяти составляет 27 петабайт в секунду — это более чем в 200 раз быстрее, чем у NVIDIA NVLink. Система CS-3, в которую устанавливается чип, по размеру сопоставима с мини-холодильником и генерирует тысячи токенов в секунду.

Дэвид Браун, вице-президент AWS по вычислительным сервисам и машинному обучению, подчеркнул: «Инференс — это место, где ИИ приносит реальную ценность клиентам, но скорость остаётся критическим узким местом». Со стороны Cerebras основатель и CEO Эндрю Фельдман добавил, что теперь каждое предприятие в мире сможет получить «ослепительно быстрый инференс в своей существующей среде AWS».

Партнёрство выглядит особенно значимым на фоне масштабных сделок Cerebras: компания недавно заключила контракт с OpenAI на $10+ миллиардов для 750 мегаватт вычислительной инфраструктуры до 2028 года. Кроме того, Cerebras планирует провести IPO во втором квартале 2026 года, что сделает её одной из крупнейших публичных компаний в сегменте ИИ-чипов.

AWS станет первым облачным провайдером, предлагающим дезагрегированный инференс Cerebras. В дальнейшем через Cerebras-оборудование будут доступны ведущие open-source LLM и модели Amazon Nova. Запуск сервиса ожидается в ближайшие месяцы, и он может существенно изменить расстановку сил на рынке облачного ИИ-инференса.