13 марта 2026 года Amazon Web Services объявила о многолетнем партнёрстве с Cerebras Systems — разработчиком крупнейшего в мире ИИ-процессора WSE-3. Чип с 900 000 ядрами и 4 триллионами транзисторов будет доступен корпоративным клиентам через Amazon Bedrock — ключевую платформу AWS для работы с фундаментальными ИИ-моделями. AWS стала первым облачным провайдером, предлагающим технологию «дезагрегированного инференса» от Cerebras.

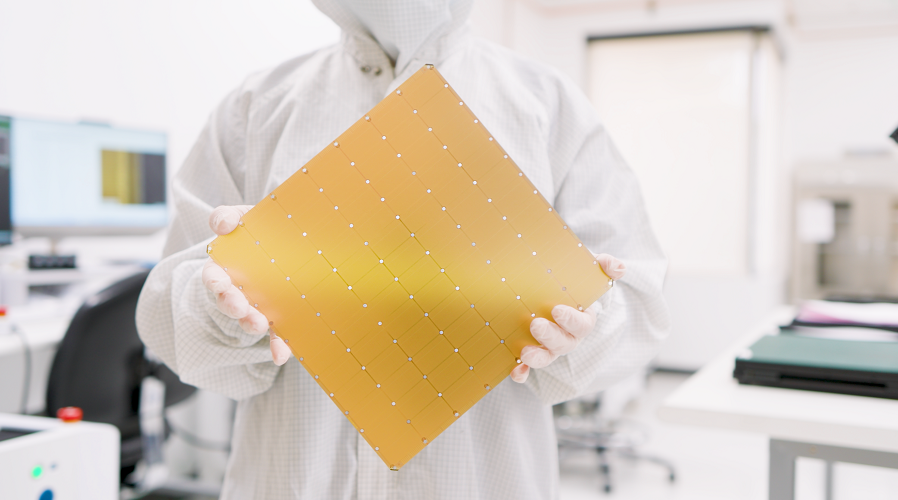

Суть технологии — в разделении процесса инференса на два этапа. Обработку входного запроса (prefill) выполняют процессоры AWS Trainium, оптимизированные для параллельных вычислений. Генерацию ответа (decode) берёт на себя Cerebras CS-3 — система размером с мини-холодильник с водяным охлаждением, содержащая чип WSE-3 площадью 46 255 мм². Связь между компонентами обеспечивает AWS Elastic Fabric Adapter, минимизируя задержки.

Цифры впечатляют: внутренняя пропускная способность памяти WSE-3 составляет 27 петабайт в секунду — это более чем в 200 раз превышает возможности NVIDIA NVLink. Чип в 56 раз больше крупнейшего GPU на рынке и обеспечивает генерацию нескольких тысяч токенов в секунду вместо сотен у традиционных GPU-решений. По заявлению AWS, общая скорость инференса вырастет в 5 раз при том же объёме оборудования.

«Инференс — это то место, где ИИ создаёт реальную ценность, но скорость остаётся критическим узким местом. Наша архитектура позволяет каждой системе делать то, что она умеет лучше всего», — заявил Дэвид Браун, вице-президент AWS по вычислениям и машинному обучению. Генеральный директор Cerebras Эндрю Фельдман добавил: «Каждое предприятие в мире сможет получить молниеносно быстрый инференс в привычной среде AWS».

На платформе Amazon Bedrock с поддержкой Cerebras будут доступны модели Amazon Nova, а также ведущие открытые LLM. Запуск ожидается в ближайшие месяцы. Среди партнёров, уже использующих CS-3, — Anthropic, OpenAI (потребляющая 2 гигаватта мощностей Trainium), Cognition и Mistral. Примечательно, что Cerebras планирует выход на IPO во втором квартале 2026 года, и сделка с AWS значительно укрепляет позиции компании перед размещением.