Совместное исследование учёных из Принстонского университета и Варшавского технологического университета показало, что радикальное увеличение глубины нейронных сетей — до 1024 слоёв вместо стандартных 2-5 — приводит к прорывному росту производительности агентов обучения с подкреплением (RL) от 2 до 50 раз в зависимости от задачи.

Учёные разработали алгоритм Contrastive RL (CRL), который обучает агентов различать, принадлежат ли действия успешным траекториям достижения цели. Система учится через самоконтроль без необходимости в человеческой разметке. Результаты оказались неожиданными: с увеличением глубины сети у агентов появлялись качественно новые навыки.

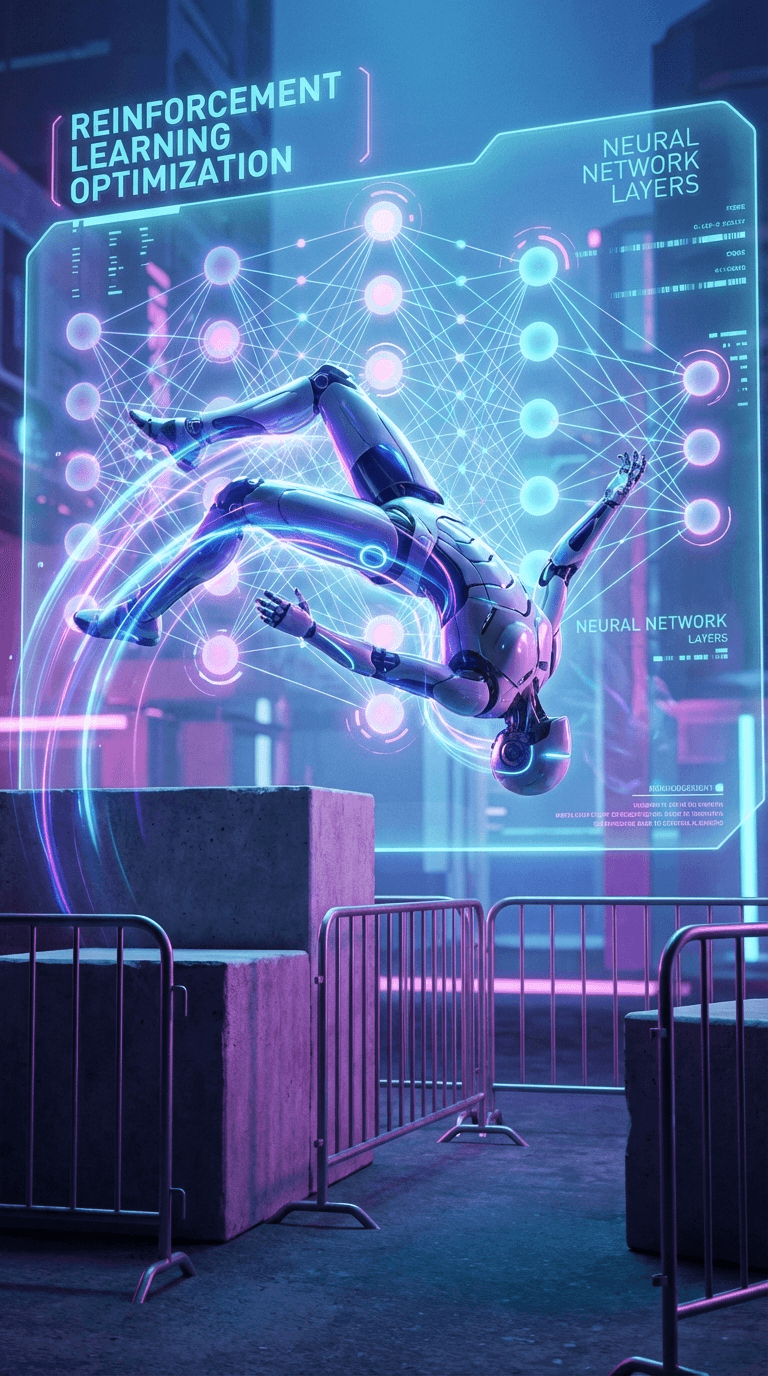

При 4 слоях агенты не могли выполнить даже базовые задачи, при 16 — научились ходить вертикально, а при 256 слоях начали демонстрировать «акробатические стратегии», включая перепрыгивание через стены. На самой сложной задаче прирост производительности превысил 1000 раз по сравнению со стандартными сетями.

Для успеха потребовалось сочетание трёх архитектурных компонентов: остаточных соединений (residual connections), методов нормализации и специализированных функций активации. Исследование ставит под сомнение давнее убеждение в RL-сообществе о том, что мелкие сети достаточны для решения задач управления, и открывает путь к созданию более ловких и адаптивных роботов.