Синтетические данные — искусственно сгенерированные датасеты, имитирующие реальную информацию без привязки к конкретным людям — стремительно становятся основой обучения ИИ-моделей. По прогнозам Gartner, к 2030 году синтетические данные превзойдут по объёму реальные в обучении нейросетей. Рынок генерации синтетических данных вырос с $288,5 млн в 2022 году до $710 млн сегодня и, по оценкам аналитиков, достигнет $2,3 млрд к концу десятилетия. Однако экспертное сообщество всё громче предупреждает: без стандартов качества и безопасности этот бум может обернуться катастрофой.

Автор исследования Марсель Момха из TechPolicy.Press описывает ключевую проблему как эффект «синтетического зеркала» — искусственные данные создают отражение реальности, которое может содержать системные искажения, предвзятость и статистические аномалии. Исследования показывают, что языковые модели исчерпают доступный человеческий текст в интернете между 2026 и 2032 годами, что делает переход на синтетические данные неизбежным. При этом ни одна международная организация пока не выпустила обязательных стандартов для их генерации, документирования и оценки.

Особую опасность представляет использование некачественных синтетических данных в агентном ИИ — автономных системах, которые действуют без постоянного контроля человека. Как подчёркивает Момха, «без стандартов и целенаправленного регулирования синтетические данные могут стать множителем рисков, особенно по мере распространения агентных ИИ-систем». Агент, обученный на искажённых синтетических данных, может принимать решения с серьёзными последствиями — от ошибочных медицинских рекомендаций до финансовых потерь.

Регуляторы начинают реагировать на вызов. Калифорния стала первопроходцем, приняв закон AB 2013 — Gen AI Training Data Transparency Act, который вступил в силу 1 января 2026 года. Закон обязывает разработчиков генеративных ИИ-систем публично раскрывать использование синтетических данных в обучении. ЕС AI Act, который достигнет полного применения 2 августа 2026 года, включает статью 10, требующую от создателей ИИ указывать источники датасетов, наличие персональных данных, защищённой интеллектуальной собственности и синтетических данных.

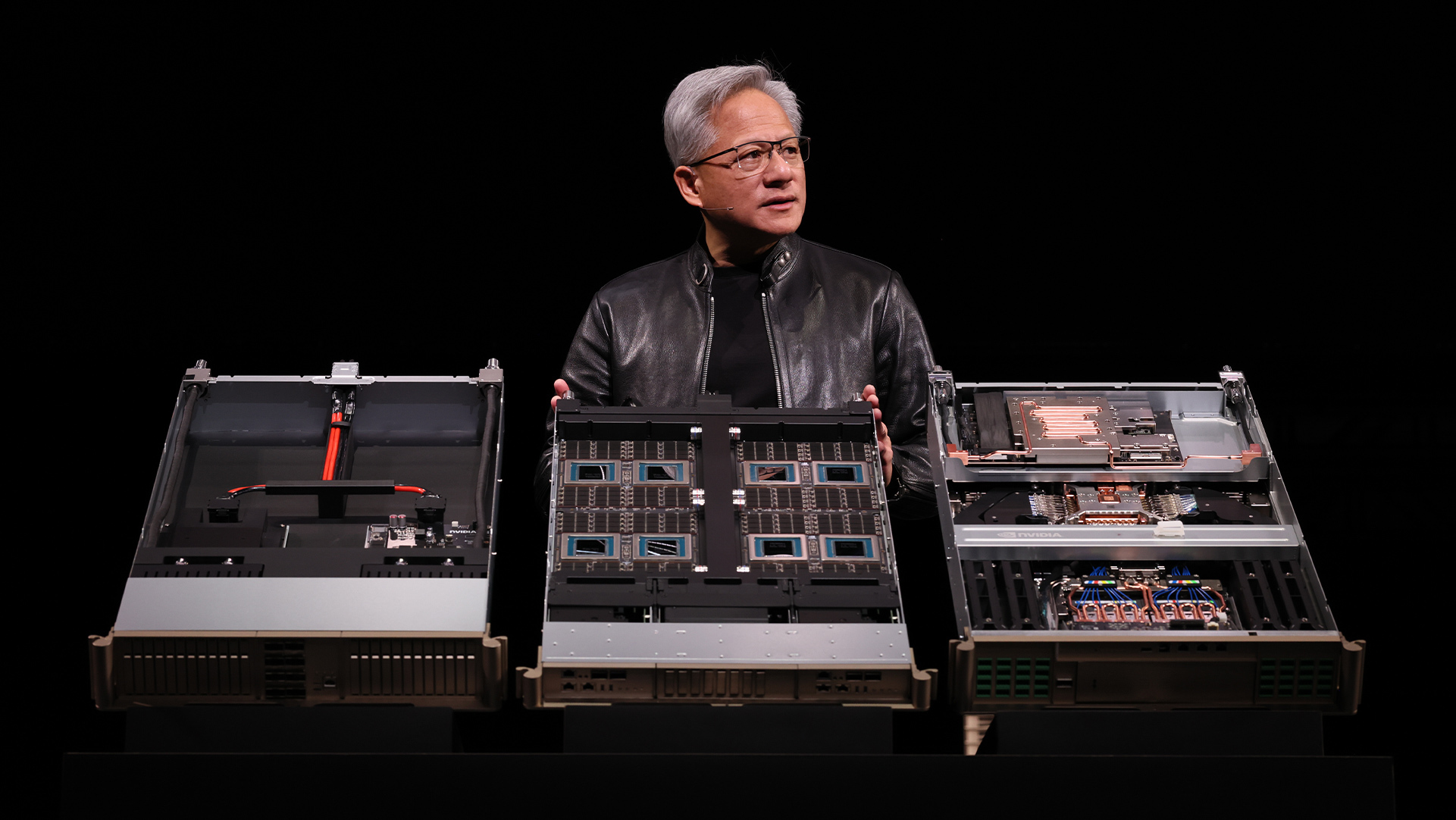

NVIDIA в 2025 году приобрела стартап Gretel.ai примерно за $320 млн, что стало крупнейшей сделкой в секторе синтетических данных. Министерство внутренней безопасности США заключило контракты с четырьмя стартапами — Betterdata, DataCebo, MOSTLY AI и Rockfish Data — для генерации синтетических данных в целях кибербезопасности. Золотым стандартом в 2026 году считается комбинация синтетической генерации с дифференциальной приватностью — технологией, добавляющей математический шум, чтобы генеративная модель не могла «запомнить» конкретного человека.

По мнению экспертов, ситуация требует скоординированных действий: международных стандартов ISO для синтетических данных, обязательных механизмов аудита и сертификации, а также «паспортов данных», документирующих происхождение и параметры каждого датасета. Без этих мер синтетические данные из решения проблемы приватности рискуют превратиться в новый источник системных ошибок ИИ. Великобритания через Управление национальной статистики и Сингапур через Комиссию по защите персональных данных уже разрабатывают свои руководства, но до единого глобального стандарта ещё далеко.